Uma Introdução ao Swoole, framework PHP assíncrono baseado em corrotinas e comparação dele com o mod...

Neste artigo trabalharemos com os conceitos fundamentais de corrotinas, canais, defer etc, também ex...

Veja como generators podem ser utilizados para criar um simples scheduler e trabalhar com corrotinas...

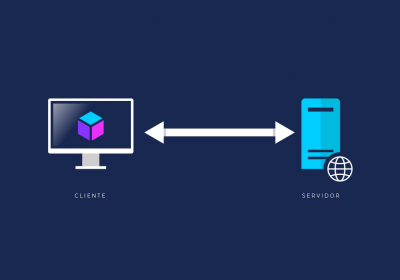

Neste artigo veremos uma introdução a WebSockets com a criação de um servidor em PHP e usando o nave...

Saiba o que são Iterators e Generators, bem como os seus casos de uso.

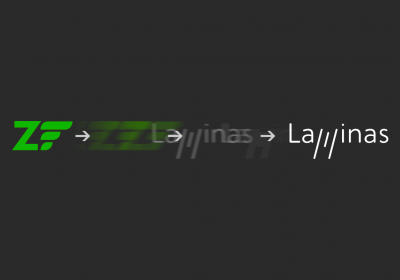

Você já ouviu falar no Laminas? Para quem não sabe, esse é o novo nome do já conhecido Zend Framewor...

Concorrência, paralelismo, processos, threads, programação síncrona e assíncrona, são assuntos que p...